[콕스 백과사전] 비전언어모델(VLM)

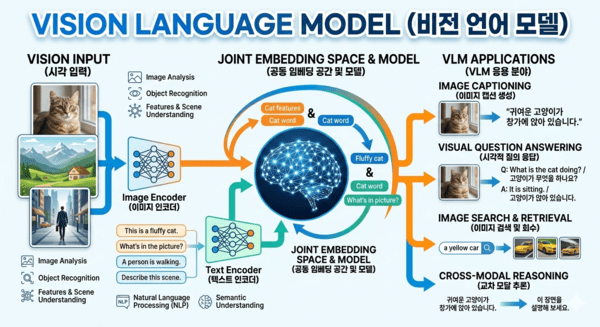

비전언어모델(VLM)은 이미지(vision)와 언어(language)를 동시에 이해하고 연결하는 인공지능 모델을 말한다.

기존 언어모델(LLM)이 텍스트 기반 질문·답변에 강점을 보였다면, VLM은 여기에 ‘시각 정보 해석’ 능력이 추가된 형태다.

예를 들어 VLM은 사진을 보고 상황을 설명하거나 이미지 속 글자를 읽어 의미를 해석하고 도표나 그래프를 분석해 요약하며 화면 캡처를 기반으로 문제 해결 방법을 안내할 수 있다. 즉, ‘보면서 이해하는 AI’라고 볼 수 있다.

보고서에는 그래프가 있고, SNS에는 사진이 넘쳐난다. 온라인 쇼핑·의료 영상·자율주행 환경 역시 시각 정보가 핵심이다. AI가 이 모든 것을 정확하게 이해하고 분석하려면 ‘언어’는 기본이고 ‘시각’ 해석 능력이 필수다.

특히 최근 등장한 멀티모달 AI 흐름 속에서 VLM은 핵심 기술로 자리 잡았다. 언어모델(LLM)에 시각 인식 모델을 결합하거나, 통합 구조로 설계해 성능을 끌어올리는 방식이다.

챗GPT는 사용자가 업로드한 사진을 토대로 내용을 분석해 설명하거나 질문에 답할 수 있다. 구글의 제미나이는 이미지·텍스트 통합 처리 기능에 강점이 있다. 메타는 이미지-텍스트 결합 연구를 지속하며 오픈소스 생태계 확대에 나서고 있다.

VLM은 단순 챗봇을 넘어 다양한 산업과 연결된다. 상품 이미지 기반 검색·추천이 필수인 이커머스 영역, 엑스레이·CT 영상과 진료 기록을 통합 분석하는 의료 분야, 설비 사진 분석을 통한 이상 탐지가 필요한 제조업 파트 등 활용 분야가 다양하다.

다만 이미지와 텍스트를 동시에 학습하려면 대규모 데이터와 높은 연산 자원이 필요하다. 시각 정보 해석 과정에서 발생할 수 있는 오판, 편향 문제도 해결 과제로 꼽힌다.