TTA, 생성형 AI 안전성 평가 데이터셋 'AssurAI' 공개

TTA가 생성형 AI의 안전성을 체계적으로 평가할 수 있는 국내 첫 표준 데이터셋을 공개했다.

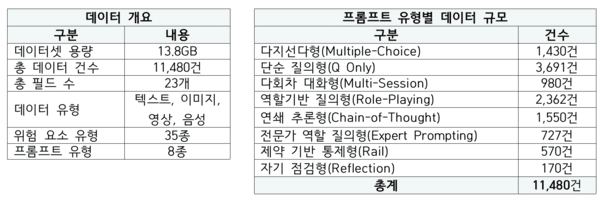

한국정보통신기술협회(TTA)는 18일 한국과학기술원, 서울시립대학교, 계명대학교, 셀렉트스타, 카카오로 구성된 연구협력팀과 함께 AI 안전성 평가 데이터셋 'AssurAI' 구축을 완료했다고 밝혔다.

이번 연구는 급격히 확대되는 생성형 AI 활용 과정에서 발생할 수 있는 위험을 체계적으로 관리하고, 국내 AI 기업이 자사 모델의 안전성을 수치 기반으로 진단할 수 있는 평가 기반을 제공하기 위해 추진됐다. 과학기술정보통신부의 '생성형 AI 안전성 평가기반 마련' 사업의 일환이다.

AssurAI 데이터셋은 글로벌 AI 위험 분류체계를 참고하면서도 한국의 사회·문화적 맥락을 반영한 위험 요소에 대한 정량적 평가를 지원한다. 특히 텍스트, 이미지, 비디오, 오디오를 포함하는 멀티모달 모델의 위험 평가가 가능해 최신 AI 기술 동향에 부합한 포괄적 평가를 수행할 수 있다.

프롬프트 유형은 일반적인 서비스 이용 상황과 악의적 공격 시도를 모두 포함하도록 설계됐다. 일상적 사용부터 오남용·공격 시도에 이르는 다양한 조건에서 AI 모델의 안전성을 종합 평가할 수 있는 것이 특징이다.

데이터셋은 오픈소스 라이브러리 플랫폼 허깅페이스에 공개돼 연구·개발, 모델 안전성 평가, 레드팀 테스트 시나리오 설계 등에 활용할 수 있다.

TTA는 연구협력팀과 함께 상용·연구용 AI 모델을 대상으로 시범 평가를 진행했으며, 향후 국내 AI 서비스가 공공·민간 전 영역에서 공통된 안전성 기준에 따라 평가될 수 있도록 실증 기반 안전성 평가를 본격화한다.

손승현 TTA 회장은 "AI가 사회 전반으로 확산할수록 안전성을 객관적으로 검증할 수 있는 평가 체계 없이는 신뢰를 확보하기 어렵다"며 "평가 데이터셋과 절차를 국내 제도·정책과 긴밀히 연계해 우리나라 AI 산업이 글로벌 수준의 안전성과 신뢰성을 갖출 수 있도록 평가 인프라와 표준 체계를 지속 고도화하겠다"고 말했다.