한 달 전 카나나-2 공개한 카카오, 업데이트 버전 추가 공개

카카오가 차세대 언어모델 ‘Kanana-2(카나나-2)’를 업데이트하고, 성능을 고도화한 4종의 신규 모델을 오픈소스로 추가 공개했다. 불과 한 달 만의 추가 공개로, 에이전틱(Agentic) AI 구현을 겨냥한 기술 경쟁력을 빠르게 끌어올렸다는 평가다.

20일 카카오에 따르면, 이번에 공개된 Kanana-2 모델의 핵심은 효율성과 실용성이다. 전문가 혼합(MoE, Mixture of Experts) 아키텍처를 적용했다. 전체 파라미터 규모는 320억개(32B) 수준이지만, 실제 추론 과정에서는 30억개(3B) 파라미터만 선택적으로 활성화한다. 이를 통해 연산량과 비용을 크게 낮추면서도 대규모 모델 수준의 지능을 유지했다.

특히 최신 초고가 GPU가 아닌 엔비디아 A100급 범용 GPU 환경에서도 원활히 구동되도록 최적화됐다. 중소기업과 연구 현장에서의 활용 가능성이 높아졌다는 말이다.

학습 방식 역시 진화했다. 카카오는 사전 학습과 사후 학습 사이에 ‘미드 트레이닝(Mid-training)’ 단계를 새롭게 도입하고, 기존 지식을 잊는 치명적 망각 현상을 줄이기 위해 ‘리플레이(Replay)’ 기법을 적용했다.

새로운 추론 능력을 추가하면서도 한국어 성능과 일반 상식 이해도를 안정적으로 유지했다.

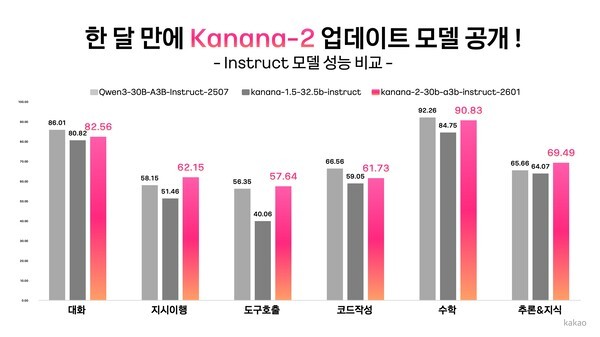

Kanana-2는 단순 대화형 AI를 넘어 에이전트 AI 구현에 특화된 점도 눈에 띈다. 멀티턴 도구 호출 데이터를 집중 학습해 복잡한 지시를 이해하고 필요한 도구를 스스로 선택·호출하는 능력을 강화했다. 실제 평가에서 동급 글로벌 모델 대비 지시 이행 정확도와 한국어 성능에서 우위를 기록했다.

카카오는 현재 수천억파라미터 규모의 MoE 모델 ‘Kanana-2-155b-a17b’를 학습 중이다. 경쟁 모델 대비 적은 데이터로도 유사한 성능을 보이며, 한국어와 수학 영역에서는 강점을 드러냈다. 카카오는 이를 발판으로 글로벌 최상위 수준의 파운데이션 모델 개발을 이어간다는 계획이다.

한편, 카카오는 20일 ▲기본(Base) ▲지시 이행(Instruct) ▲추론 특화(Thinking) ▲미드 트레이닝 모델 등 4종을 오픈소스로 공개했다.