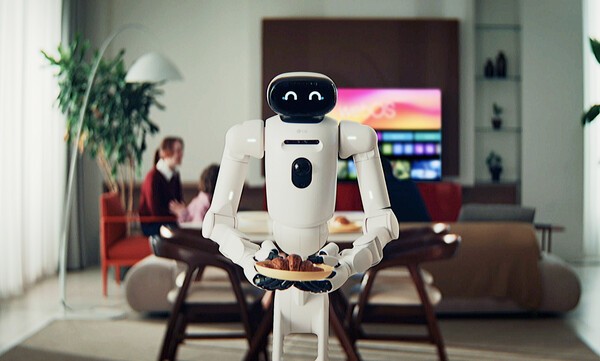

[신상 프로필] '제로 레이버 홈' 실현 AI 홈로봇 'LG 클로이드'

LG전자는 6일(현지시간) 미 라스베이거스에서 개막하는 CES 2026에서 AI 홈로봇 'LG 클로이드(LG CLOiD)'를 공개한다고 4일 밝혔다.

LG 클로이드는 LG전자 가전 사업의 궁극적 목표인 '제로 레이버 홈(Zero Labor Home, 가사 해방을 통한 삶의 가치 제고)' 실현을 위한 핵심 제품이다. 스케줄과 주변 환경을 고려해 작업의 우선순위를 정하고, 여러 가전을 제어하며 가사를 직접 수행하는 비서 역할을 한다.

클로이드는 출근 준비로 바쁜 거주자를 대신해 식사 계획에 따라 냉장고에서 우유를 꺼내고 오븐에 크루아상을 넣으며 아침 식사를 준비한다. 차 키와 프리젠테이션 리모컨 등 일정에 맞춰 준비물도 챙겨 전달한다. 거주자 출근 후에는 세탁물을 세탁기에 넣고, 완료된 수건을 개어 정리한다. 청소로봇 동선의 장애물도 치워 빈틈없는 청소를 돕는다.

클로이드는 머리와 두 팔이 달린 몸체, 휠 기반 자율주행 기술이 적용된 하체로 구성된다. 허리를 조절해 105㎝부터 143㎝까지 키 높이를 바꾸며, 약 87㎝ 길이의 팔로 바닥이나 높은 곳의 물체도 잡을 수 있다.

몸체의 두 팔은 어깨 3가지(앞뒤/좌우/회전), 팔꿈치 1가지(굽혔다 펴기), 손목 3가지(앞뒤/좌우/회전) 등 총 7가지 구동 자유도로 움직인다. 이는 사람 팔의 움직임과 동일한 수준이다. 5개 손가락도 개별 관절을 갖춰 섬세한 동작이 가능하다.

머리는 이동형 AI홈 허브 'LG Q9' 역할을 수행한다. 로봇 두뇌인 칩셋, 디스플레이와 스피커, 카메라와 각종 센서, 음성 기반 생성형 AI가 탑재됐다. 인간과 언어·표정으로 소통하고 거주자의 라이프스타일과 주변 환경을 학습하며, 이를 기반으로 집안 가전을 제어한다.

LG전자는 칩셋에 자체 개발한 VLM(Vision Language Model, 시각언어모델) 및 VLA(Vision Language Action, 시각언어행동) 기술을 적용했다. 피지컬 AI 모델을 기반으로 가사 작업 데이터를 수만 시간 이상 학습시켜 홈로봇에 최적화했다. VLM은 시각 정보를 언어로 해석하고 언어 명령을 시각 정보와 연관지어 통합 이해하며, VLA는 이를 바탕으로 구체적 행동을 계획하고 실행한다.

LG전자는 이번 전시에서 로봇용 액추에이터 브랜드 'LG 액추에이터 악시움(LG Actuator AXIUM)'도 처음 공개한다. 액추에이터는 로봇의 관절 역할을 하는 핵심 부품으로, LG전자는 연간 4천만 개 넘는 고성능 모터를 자체 생산하며 축적한 부품 기술력을 바탕으로 경량화·고효율·고토크 등 핵심 경쟁력을 구현할 계획이다.